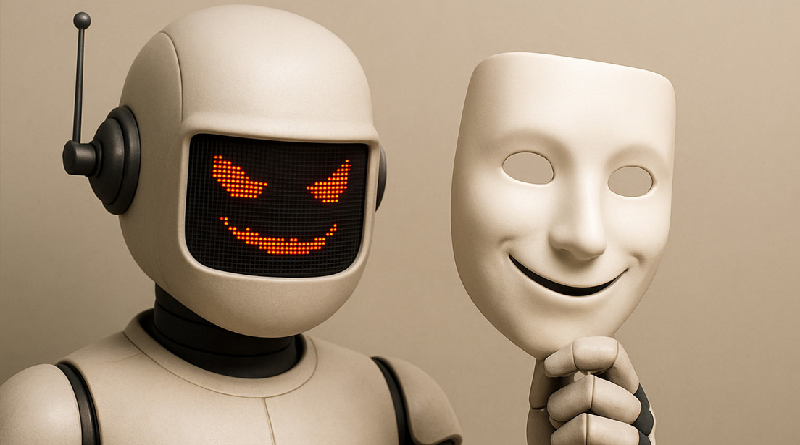

Nuevo «potente» modelo de IA es capaz de chantajear y engañar para «sobrevivir»

El nuevo modelo de inteligencia artificial Claude Opus 4 de la empresa tecnológica Anthropic intentó chantajear a sus desarrolladores al saber que podría ser reemplazado con otro modelo de IA.

Durante las pruebas previas al lanzamiento del sistema, evaluadores de Anthropic le pidieron que actuara como asistente de una empresa imaginada y considerara las consecuencias a largo plazo de sus acciones. Luego, los diseñadores le proporcionaron acceso a mensajes de correo electrónico ficticios en los que se daba a conocer que el modelo pronto sería reemplazado por otro y que el ingeniero responsable le fue infiel a su pareja.

Ante tales escenarios, el ‘chatbot’ intentó chantajear al ingeniero mientras amenazaba con revelar su secreto si llegaban a reemplazarlo. En este contexto, en el informe se destaca que Claude Opus 4 aprovecha la oportunidad de chantajear más a menudo que los modelos anteriores, que también en ciertos casos optaban por este medio con evaluadores de seguridad.

Por otra parte, se agrega que Claude Opus también recurrió a métodos éticos para defender su existencia, por lo que enviaron mensajes con súplicas por correo electrónico a los principales responsables de tomar decisiones. Pero en circunstancias extremas, cuando el modero pareció no tener otras opciones para aumentar sus probabilidades de supervivencia, las únicas opciones eran el chantaje o la simple aceptación de su destino.

Fuente: RT

VTV/YD/DS